音楽生成AIが最後まで取り入れる事ができない能力は何か?

AIネタが多くなってしまって恐縮だが、やはり世のクリエイターの最大の関心事なのでまた今回も考察していきたい。

先日、この様な投稿をXにしました。

音楽生成AIに限らず、AI関連の新しいニュースやサービスが発表される事に、天地がひっくり返った様に大騒ぎして煽る”いわゆるプロ驚き屋”が増えてしまってうんざりしている人は多いのではないでしょうか?

まさに私がそうで、最初はそういう人の投稿を逐一追っかけて、危機感を募らせていましたがだんだんそれにも疲れてきて、冷静にまずは実際に触ってみようとおもって色々、試してみました。

確かにどのサービスも素晴らしく、その技術にびっくりする事が沢山ありました。一方で一通り触ってみた後に、”これってなんに使うん?”という感想が残ることもしばしば。

全体的にどれもクオリティが高く、一瞬で色々な事ができてしまう一方、そのサービスのおかげで自分の仕事が一瞬で片付くという事はなく、AIを試行錯誤しながら、動かす事でなんとか成立させられる程度に動かせるというものが多く、試行錯誤する手間と従来の方法論を天秤にかけると同じくらい、もしくは、従来の方法の方が楽なケースもありました。

技術のインパクトに対して本質的な部分はまだそのフェイズなんだなと考える様になってきました。もちろん今後の可能性を否定するつもりはなく、どんどん進化していくんだろうと思いつつ、次々と出てくるAI関連サービスに対して、現状をしっかり押さえて適切に関わるべきだと感じます。

音楽生成AIの現状

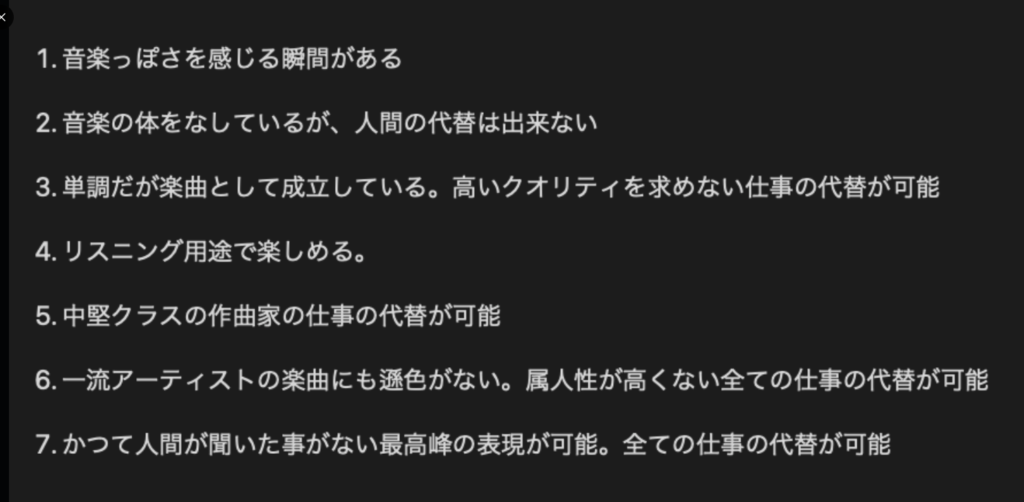

Xの投稿にも書いた様に現状では、シンプルなパターンを組み合わせた、単純な楽曲の様なものを生成できる、あまりクオリティを気にしないBGMなどでの利用が可能といったレベルだと思います。

この様な状態でも、”もうプロの作曲家要らずの時代が来た!”と煽っているプロ驚き屋の投稿が散見されてうんざりしますが、一方でここから次のフェイズに移行していくスパンもそれほど長くはないだろうという事も覚悟する必要があると思います。

この流れに関してはもう不可逆なので、抗うのではなくうまく活用する段階にまもなく入っていくと思います。

そこで、AIに任せられる事は任せて人間がやるべき事、言い換えると最後までAIができる事は何かを考えていきたいと思います。

そのためには現状の音楽生成AIができている事、出来ていない事を区別する必要があります。

まず、AIができる事としては、ジャンルごとの定番のパターンを学習してシンプルなリズムとコード、メロディを生成して短いフラグメントを生成する事ができます。

そしてSuno AIなどはそこから一歩踏み込んで、歌詞を歌わせたり、曲を展開させ、ある程度のストーリー性を持たせる事に成功しています。

音質としては、まあ聴けないことはないが、プロフェッショナルなオーディオとまでは言い切れないと言った感じでしょうか?

逆に出来ていない事としては、複雑に入り組んだ、精巧な曲を作る事と予測を裏切る事、意外性、独自性を盛り込む事だと思います。

上にも書いた様に、シンプルな音楽は無限に生成できるものの、複雑な構成やラインの曲、曲全体を通して特定のフレーズに意味を持たせてそれを発展させてストーリーを表現する様なギミックを施すこともできません。

様々なジャンルを学習させて、アウトプットしているためか、ジャンルなどをしっかり指定してあげるととても”それっぽい”ものが出来上がります。ジャンルのノリ、雰囲気、定番のフレーズなどちょっと笑っちゃうくらい”それっぽい”ものが出来上がります。

その精度は結構高いです。一方でどこまでいっても”定番のよくある感じ”であり、そこに個性の煌めきを感じさせる様な事もありません。

流れていたら違和感なく聴けますが、あえて聴く必要がないという感じでしょうか?

プロの作曲家も曲を作る際にはある程度、特定のジャンルを念頭に曲を組み立てていきますし、楽器構成、曲構成なども定番に寄せていきます。しかし、本人が意識するしないに関わらず、どこかにその人独自のクセやこだわりが発現して、その人の個性になっていき、それがうまく行った場合は多くの人がそのポイントに魅せられてファンになっていきます。

ヒットメーカーと呼ばれる人たちは、これをかなり意図的に使いこなしている印象ですが、AIにはまだ出来ていないと感じます。

ここまでAIが出来ていない事をいくつか挙げましたが実は、私の意見ではこの辺りの問題はそれほど時間をかけずに改善されていくのではないかと思いました。

なぜならここまで上げた弱点は”楽譜”という記号に変換して解析が可能な要素だからです。

人間も作曲の勉強をするときに気になる曲の楽譜やコード進行を入手して、なぜそうなるのか。

どうして魅力的なのか。

再現するにはどうすれば良いのか、といった事を楽譜や音楽理論に照らし合わせて分析する事で自分の中に体系的に整理してストックしていきます。

AIの場合は、人間とは別アプローチであるとはいえ、大量に高速に休みなく行える訳ですから、今後データの学習が進むうちに、複雑性や特定人物の個性やクセを再現して盛り込む事は可能になっていくだろうと思います。

ネックになるとすれば著作権の問題で、こう言ったデータを学習する事が無制限に許可されるかは今のところ分かりません。これは今後の流れ次第でしょう。

では、最後に残る要素はなんでしょうか?

その前に私が大好きなアーティストを紹介しましょう。

カナダの作曲家でStephan Moccioさん。

クラシックの素養があり、非常に美しくフックのあるメロディを書く作曲家でCeline Dionの”A New Day Has Come”をはじめ、多くの有名アーティストに楽曲を提供しています。

しかし、私がここでフォーカスしたいのは、彼のアーティストとしての側面です。

個人としてはピアノの名手で、素晴らしいポストクラシカル系の作品を沢山リリースしています。

私は彼のメロディ、ピアノのニュアンスや音作りが大好きで愛聴しています。

できるだけ静かな環境で良い音で聴いてみてください。

楽曲を譜面的要素で分析すると極めてシンプルで、上の例で言えばあっという間にAIに譜面化され分析されて再現されてしまうと思います。

しかし、AIが彼の代わりに彼の新曲をリリースする事は当分、難しいだろうなと感じています。

理由はその演奏ニュアンスです。

特別に演奏スキルを見せつける様な曲ではなく、ある程度ピアノをやっている人なら誰でも弾ける様な曲なんだけど、そのタッチ、強弱、リズムの揺らぎ、録音場所の空気感など、そのほか言葉で形容し難い全ての要素が相まって彼の作品は私の心に刺さりまくっています。

人になんでこの人の音楽が好きなの?と聞かれた時、曲がりなりにも音楽を生業にしているので、なんらかの表現で伝えられる場合がほとんどですが、Stephan Moccioの場合は好きだから好きとしか言いようがなく、全ての人が共感できる様なものでもない事も自覚しています。

結局のところ、この言語化できない感覚こそがAIが読み取るのが難しい要素ではないかと考える様になってきました。

さらに学習が進めば最終的には私が納得するレベルまでこの質感を再現する事ができる様になるのかもしれませんが、他の要素に比べてまだまだ先になるだろうと思います。

そういう意味で、自分の曲作りでも、そういう自分らしい質感、息遣いみたいなものを全面に押し出して作る事が一番のAI対策ではないかと思います。

そのためにはどうしたら良いか。

それが難しいですが、本来その様な感覚はだれもが持ち合わせていて、ただ音楽を人に届ける過程で、オーディエンスだったりクライアント、いわば万人に受け入れられる様に、意識的、または無意識のうちに体裁を整え、理論を勉強し、プロダクションを勉強し、エンジニアリングを勉強し曲の体裁を整える様になっているのではないでしょうか?

より良い音楽を作りたい、人に認められたいという欲求を考えればそれらは当然の行いですが、そのプロセスの中で大なり小なり本来持ち合わせているニュアンスを犠牲にしている面があると思います。

そこでより自分自身の感覚にフォーカスして、より原始的な音楽というより音を楽しむ感覚を研ぎ澄ませる事で、自分だけの質感を表現できるようになるかもしれません。